Un reciente anuncio publicitarios realizado con Inteligencia Artificial (IA) empleó miles de imágenes de una cantante ya fallecida, un método no exento de polémica, conocido como deepfake.

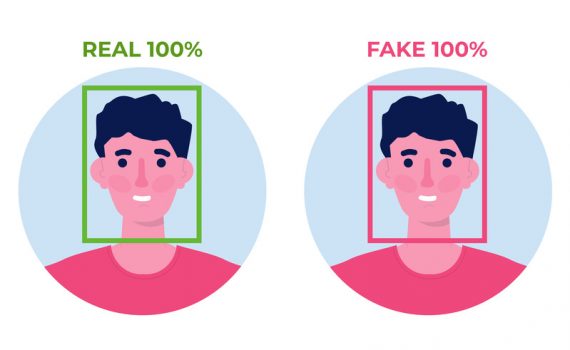

Mediante la técnica del deepfake, es posible editar vídeos falsos de personas con un parecido razonable con la realidad.

Recientemente, una marca de cerveza española “resucitó” a la cantante fallecida Lola Flores, a través de la edición de miles de imágenes. Esta tecnología permite que personajes ya fallecidos continúen participando en películas o anuncios. Sin embargo, su empleo también puede contribuir a la desinformación.

En un año marcado por las noticias falsas relacionadas con la pandemia, anuncios como el anteriormente mencionados también podrían ser parte del problema, según el uso que se haga de esta tecnología.

Las elecciones presidenciales de Estados Unidos de noviembre del pasado año provocaron un aluvión de vídeos circulando por Internet, en el que los rostros de los candidatos se superpusieron sobre los de otras personas cuyas declaraciones no se correspondían con la realidad.

Precisamente, para frenar posibles vídeos falsos relacionados con las votaciones, la empresa Microsoft creó un sistema para certificar la veracidad de los vídeos. Concretamente, mediante la plataforma Video Authenticator, es posible detectar errores imperceptibles para el ojo humano.

Uno de los usos ilícitos y más peligrosos de los deepfakes se produjo hace unos años, con el uso de imágenes de celebridades en páginas de pornografía. El incesante goteo de imágenes personales en redes sociales son un elemento perfecto para que cualquier persona pueda ser víctima de este tipo de delitos.

Para detectar este tipo de contenido falso, las personas deben prestar atención a determinados detalles que marcan la diferencia entre realidad y ficción. La Escuela de Negocios de la Innovación y los Emprendedores (IEBS) ofrece algunos consejos para certificar la veracidad de las imágenes:

- El parpadeo de la persona es un indicador para averiguar si estamos ante un deepfake. “El algoritmo de los DeepFake no puede parpadear a la misma velocidad que un humano”, indica esta escuela.

- En esta técnica, normalmente la cara es el único elemento que se modifica, por lo que la postura o el cuerpo de la persona pueden ayudar a detectar anomalías.

- Los deepfakes suelen tener una duración corta.

- Es conveniente buscar a la persona que compartió el vídeo por primera vez, para entender el contexto.

- La mala sincronización entre el sonido y la imagen es otra señal de alerta.

- Los detalles son siempre importantes. “La Inteligencia Artificial todavía está luchando para representar correctamente los dientes, la lengua y la cavidad bucal cuando habla”, concluye la IEBS.

FUNIBER patrocina una gran variedad de programas universitarios destinados a ofrecer a los profesionales toda la información necesaria para entender el funcionamiento de las nuevas tecnologías. Uno de los cursos ofrecidos es la Maestría en Dirección Estratégica en Tecnologías de la Información.

Fuentes: Deepfake: ¿amenaza para el orden mundial o el futuro del entretenimiento?

Microsoft ya detecta los deepfakes: así son sus armas contra la desinformación

¿Qué son los Deepfakes y cómo detectarlos?

Foto: Todos los derechos reservados.